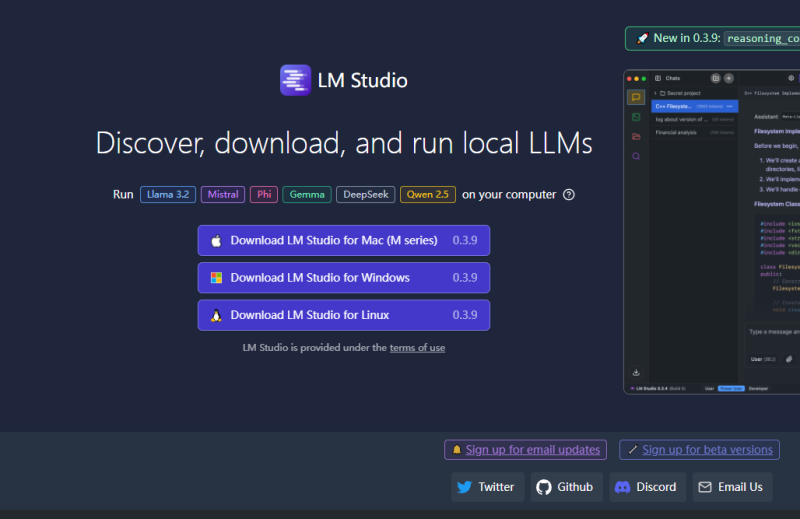

LM Studioh和ollama在本地部署deepseek上有哪些技术优势

LM Studio 和 Ollama 都是用于本地运行大型语言模型(LLM)的工具,但它们在设计目标、使用方式和适用场景上有显著区别。以下是两者的详细对比: 1. 核心定位 特性 LM Studio Ollama 目标用户 ...

局域网内其他设备访问本地部署的deepseek,实现手机畅快问答

目的 使用ollama + pageassist + deepseek大模型,实现局域网内访问本地部署的大模型,手机也能畅快问答。 使用LmStudio + deepseek + vscode(continue) ,实现低配置电脑也可快速生成代码。 1....

VSCode与DeepSeek结合实现

前言使用 DeepSeek 给出代码建议或直接生成代码是十分简单。结合我们现有的工具就可以轻松部署。1. 下载安装 VSCode从微软官网下载并安装 VSCode ,官网地址:https://code.visualstudio.co...

Lm studio本地部署DeepSeek 及 部署后的性能调节

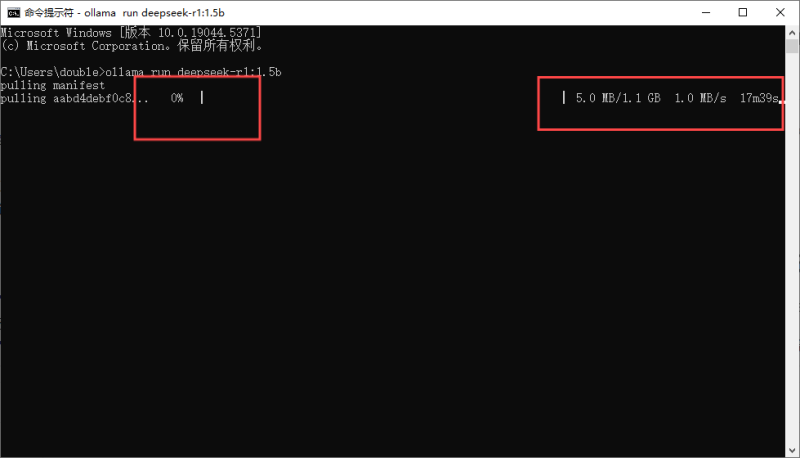

0. 前言 上一节内容讲到Ollama部署deepseek的方法,会有下面几方面问题: Ollama官网访问安装包下载失败 下载deepseek模型文件过慢或失败 在不进行环境配置的情况下,默认安装至C盘,导致空间不...

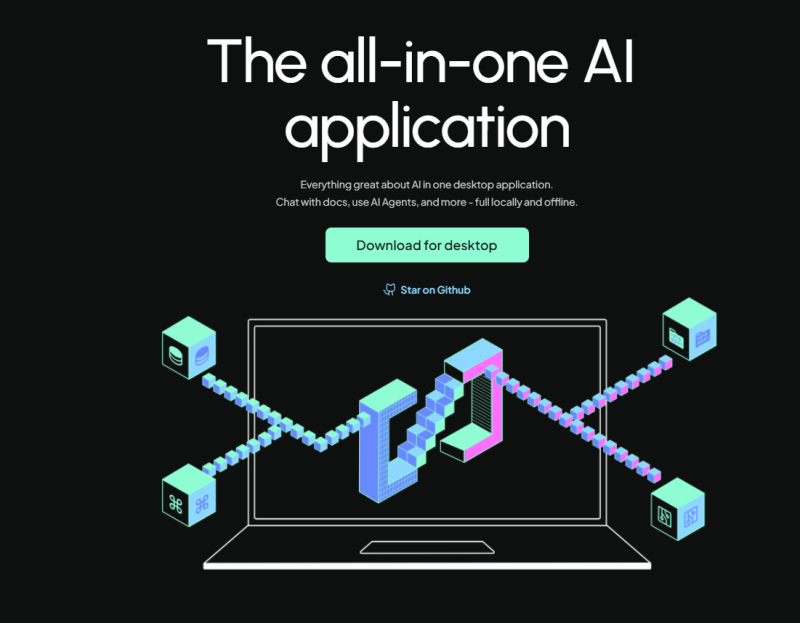

AnythingLLM向deepseek提交文件、网页内容,使其回复更准确

目的 无法使用 ollama 部署又有数据投喂需求,使用 LMstudio + AnythingLLM 向 deepseek 提交数据 相较于 pageassist , AnythingLLM 可提交网页内容 1. 下载 及 安装 AnythingLLM 访问 https:/...

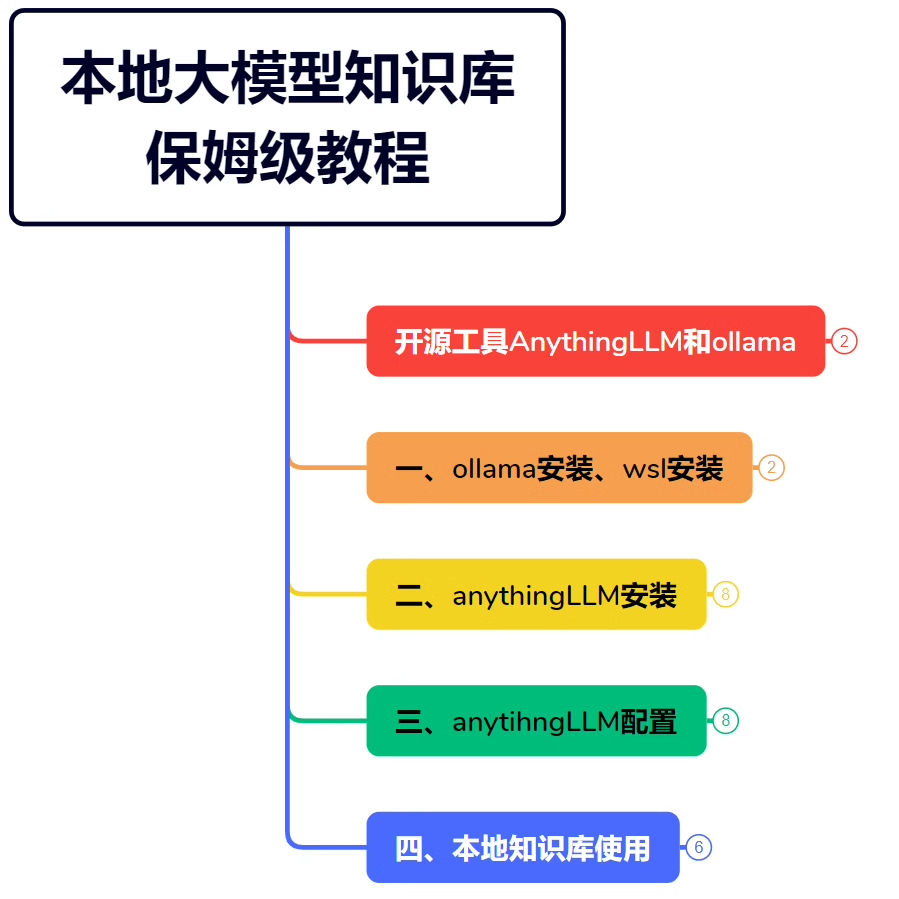

AI大模型 本地知识库 anythingLLM 轻松搭建本地大模型知识库

一、AnythingLLM:私有化智能知识库构建专家1. 文档管理与智能问答135多格式支持:可处理 PDF、TXT、DOCX、JSON 等文档类型,支持从本地文件、网页链接或 GitHub 等平台导入数据,并自动解析文...

Ollama、docker、chatbox、Cherry Studio、Visual Studio工具包

【免费】提供官方下载地址(比较慢),下方链接自行下载。 【收费】的是提前下载好的,购买之后有网盘链接下载。 付费内容有Ollama、docker、chatbox、Cherry Studio、VsCode、AnythingLLM、Off...

搭建同款知识付费网站

温馨提醒:更新主题请务必记得清空浏览器缓存、刷新CDN缓存(如果有的话)、刷新Redis或Memcached缓存(如果有的话)、再保存一下主题设置,并查看一下更新日志哦!V8.12025-01-01新功能更新适配 Wo...

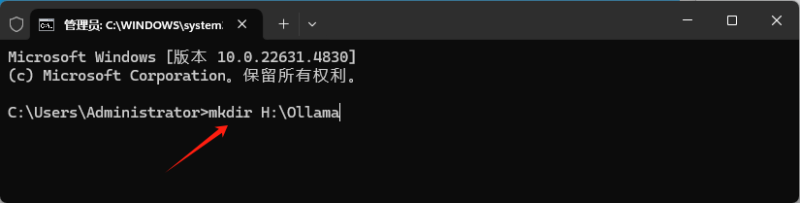

自定义Ollama安装路径

方法一:通过符号链接重定向安装目录下载Ollama安装包下载地址:Ollama、docker、chatbox、Cherry Studio、Visual Studio 工具包卸载现有Ollama(如已安装)打开控制面板 → 卸载程序 → 找到 O...

Ollama+DeepSeek本地部署教程及相关资料

环境准备操作系统:支持 macOS、Linux(推荐 Ubuntu/Debian)或 Windows(需 WSL2)。确保系统已安装最新驱动和依赖库。硬件要求:CPU:建议至少 4 核以上。内存:16GB+(7B 模型需 8GB+,13B ...