排序

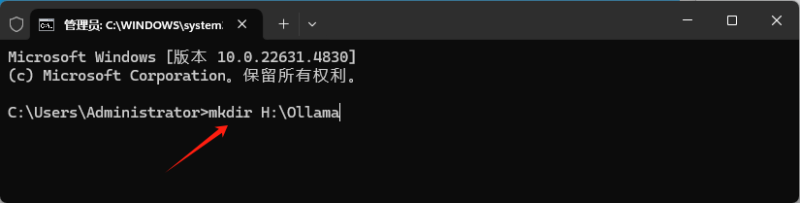

自定义Ollama安装路径

方法一:通过符号链接重定向安装目录下载Ollama安装包下载地址:Ollama、docker、chatbox、Cherry Studio、Visual Studio 工具包卸载现有Ollama(如已安装)打开控制面板 → 卸载程序 → 找到 O...

宝塔面板部署DeepSeek教程

前提条件 已安装宝塔面板 在服务器部署DeepSeek多用户可以注册去使用 操作步骤 DeepSeek 可以使用CPU进行推理,但是推荐使用NVIDIA GPU加速,文末将介绍如何使用NVIDIA GPU加速。 登录宝塔面板...

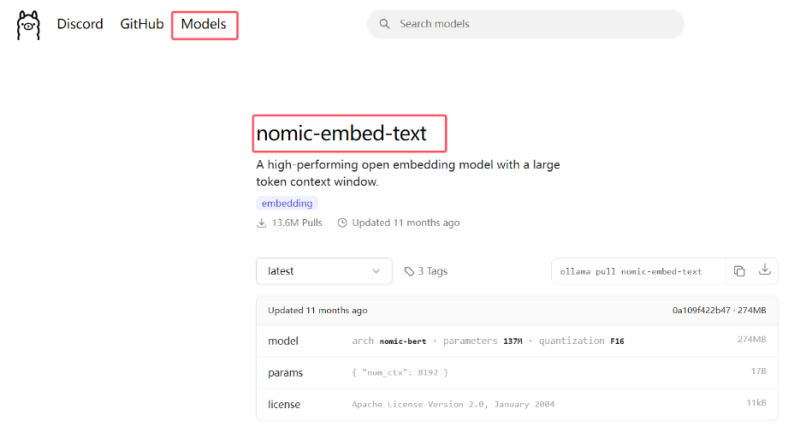

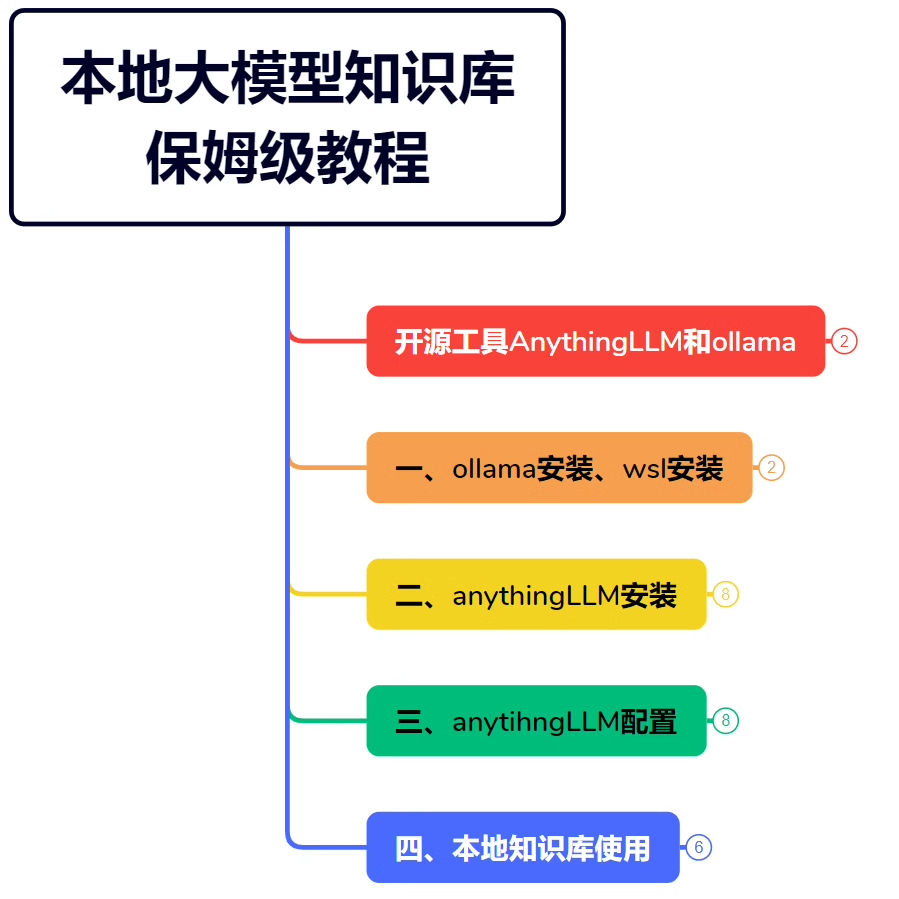

本地Deepseek添加个人知识库(Page Assist/AnythingLLM)

本地Deepseek两种方法建立知识库前言 (及个人测试结论)法一、在Page Assist建立知识库step1 下载nomic-embed-textollama官网->models->nomic-embed-textcmd进终端输入(依然默认进了系...

DeepSeek本地部署教程+可视化界面+入门操作指南

教程说明1、大家可以根据本文档步骤安装使用。2、看不懂文档的,可以看安装教程视频,跟着视频里一步一步操作。deepseek本地部署视频教程:https://26794125.s21v.faiusr.com/58/ABUIABA6GAAg5L...

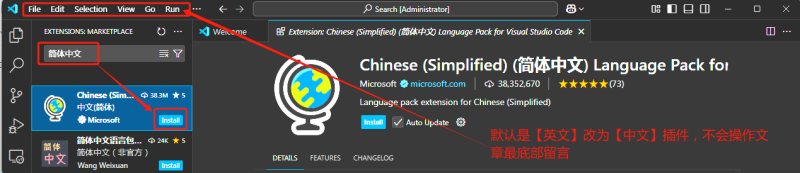

vscode接入deepseek

第一步下载vscode并安装简体中文-vscode安装包已上传网盘第二步安装Continue插件-插件已上传网盘第三步添加模型第四步申请Deepseek官方API-api快捷方式已上传网盘第六步把创建好的Deepseek的API...

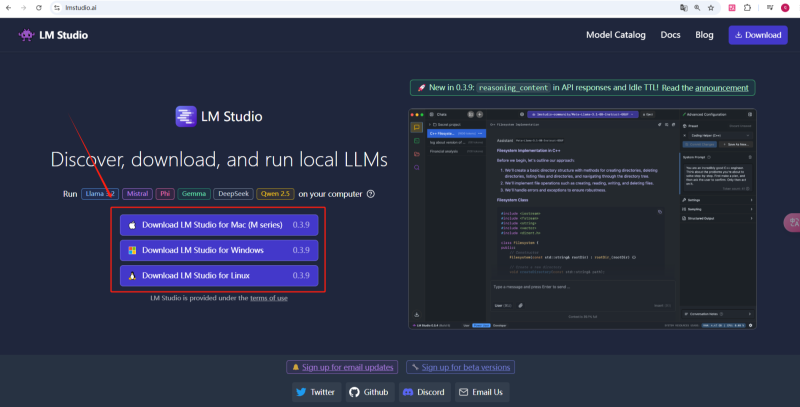

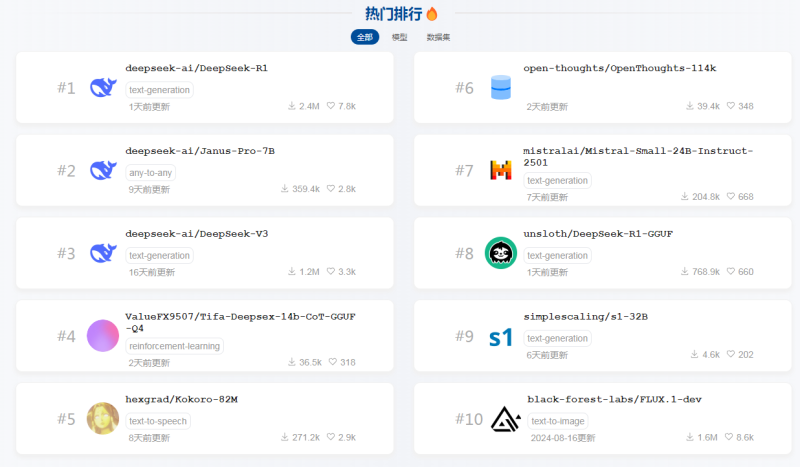

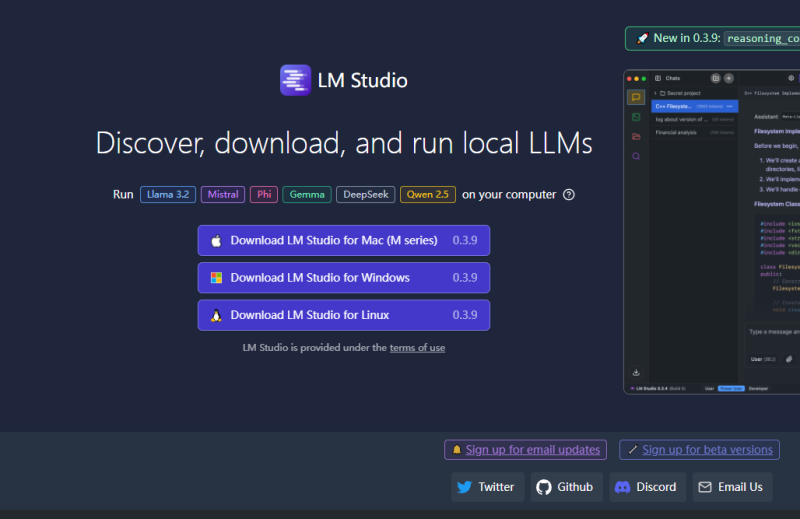

LM studio部署本地Deepseek精度模型包

DeepSeek模型选择和下载根据博主的提供的参数,先清楚自己能够使用多大的模型,再进行下载。根据自己电脑的显卡配置和需求选择合适的模型下载,可以先下载1个尝试,模型是可以下载多个并灵活切...

Lm studio本地部署DeepSeek 及 部署后的性能调节

0. 前言 上一节内容讲到Ollama部署deepseek的方法,会有下面几方面问题: Ollama官网访问安装包下载失败 下载deepseek模型文件过慢或失败 在不进行环境配置的情况下,默认安装至C盘,导致空间不...

AI大模型 本地知识库 anythingLLM 轻松搭建本地大模型知识库

一、AnythingLLM:私有化智能知识库构建专家1. 文档管理与智能问答135多格式支持:可处理 PDF、TXT、DOCX、JSON 等文档类型,支持从本地文件、网页链接或 GitHub 等平台导入数据,并自动解析文...